Quando os primeiros celulares com câmera apareceram, eles possuíam sensores simples e baixa qualidade. Com a chegada dos smartphones, a câmera começou a ser uma das características mais exigidas em qualidade pelos consumidores. Porém, as técnicas de pós-processamento e compressão aplicadas nas fotos podem entregar um resultado indesejado ou com uma qualidade aquém do que a câmera pode entregar.

Para resolver esse ponto, diversos apps foram lançados. A Adobe, com conhecimento de causa, resolveu lançar uma versão do Adobe Lightroom CC para smartphones e adicionou a opção de câmera profissional. O Lightroom já é o aplicativo para desktop mais usado por fotógrafos profissionais há anos e agora a versão para mobile e desktop compartilham as mesmas opções (assim como está acontecendo com diversos outros programas da Adobe).

O Adobe Lightroom CC está disponível para Android e iOS de forma gratuita. No caso do Android, algumas funções disponíveis estarão disponíveis dependendo do modelo aparelho. Essa distinção do Android acontece por causa da forma com que o app comunica-se com a câmera, obrigando o desenvolvedor a criar algumas soluções específicas por aparelho. Por isso, consulte a página do GooglePlay, caso use Android, para verificar quais dispositivos possuem as funções completas. No caso do iOS, todas as funções estão disponíveis para os dispositivos com ao menos 12Megapixels na câmera.

Câmera

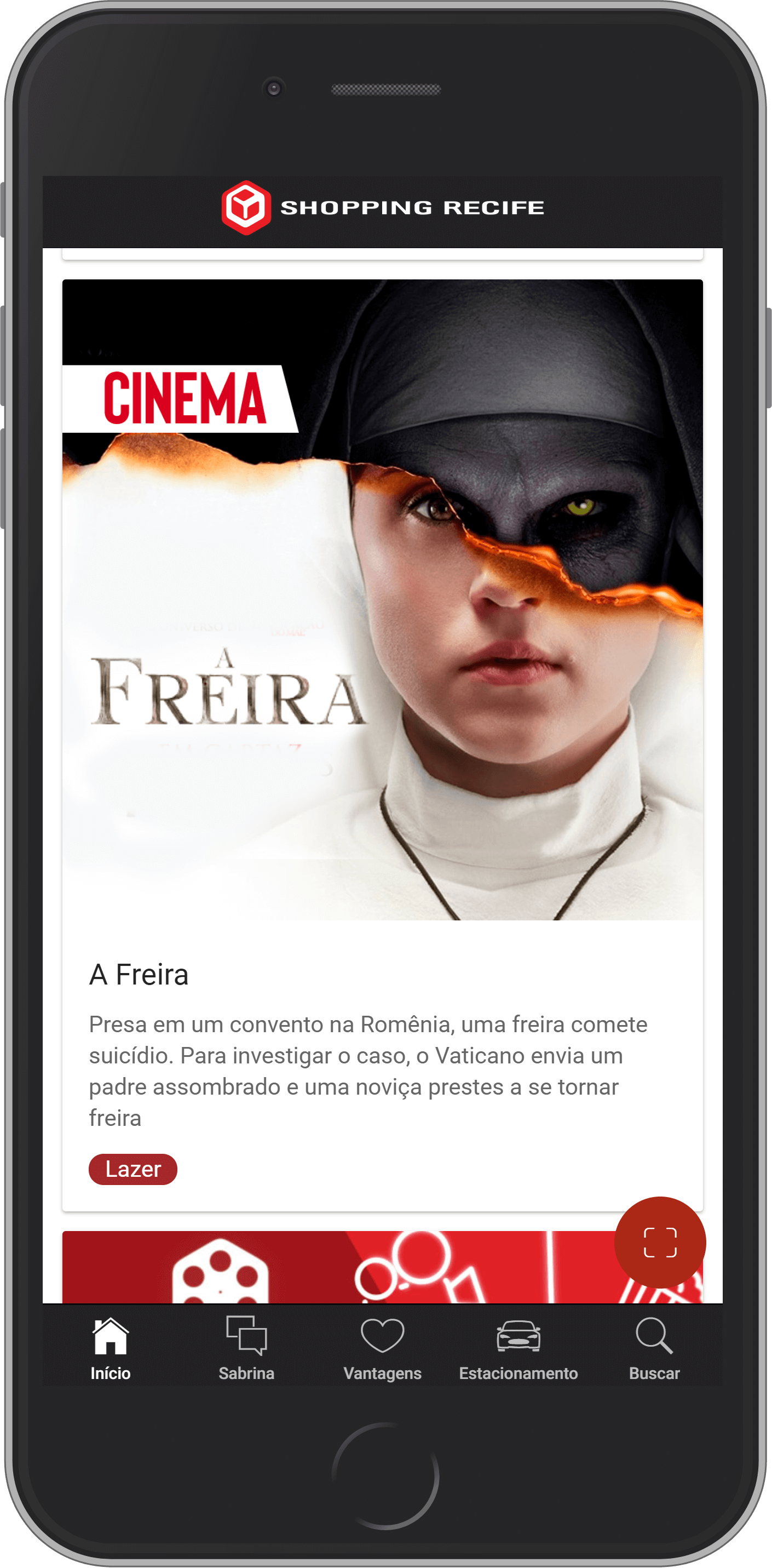

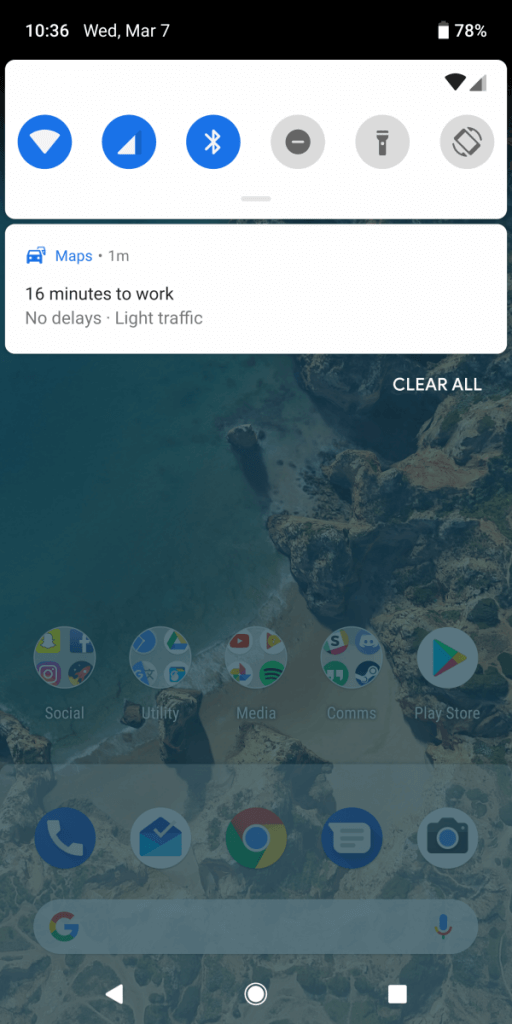

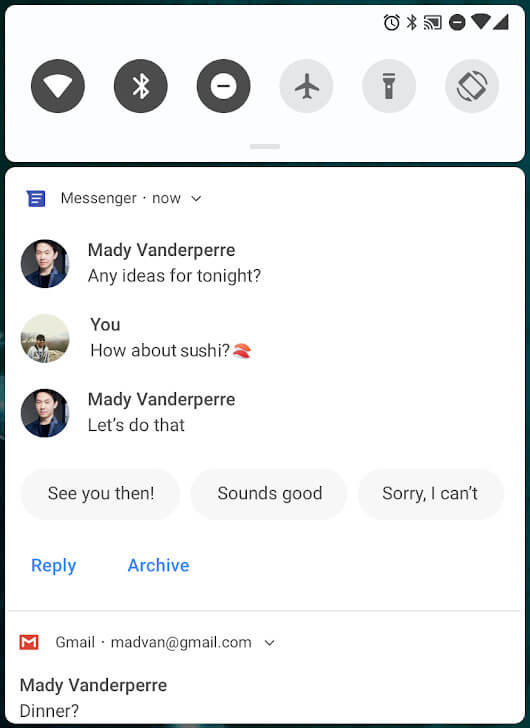

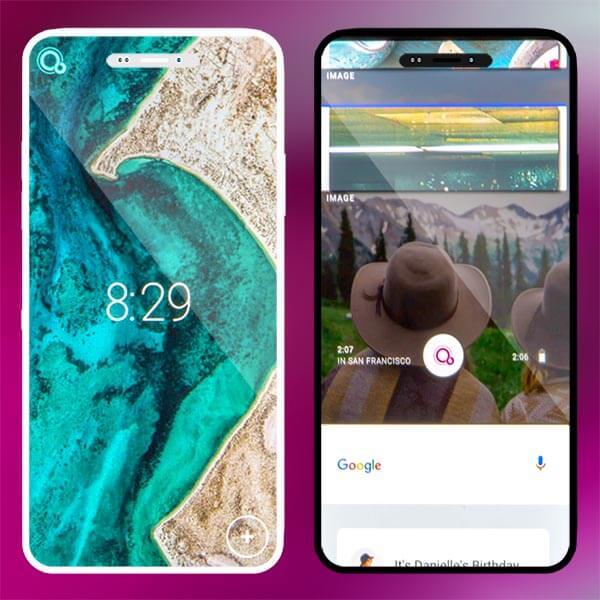

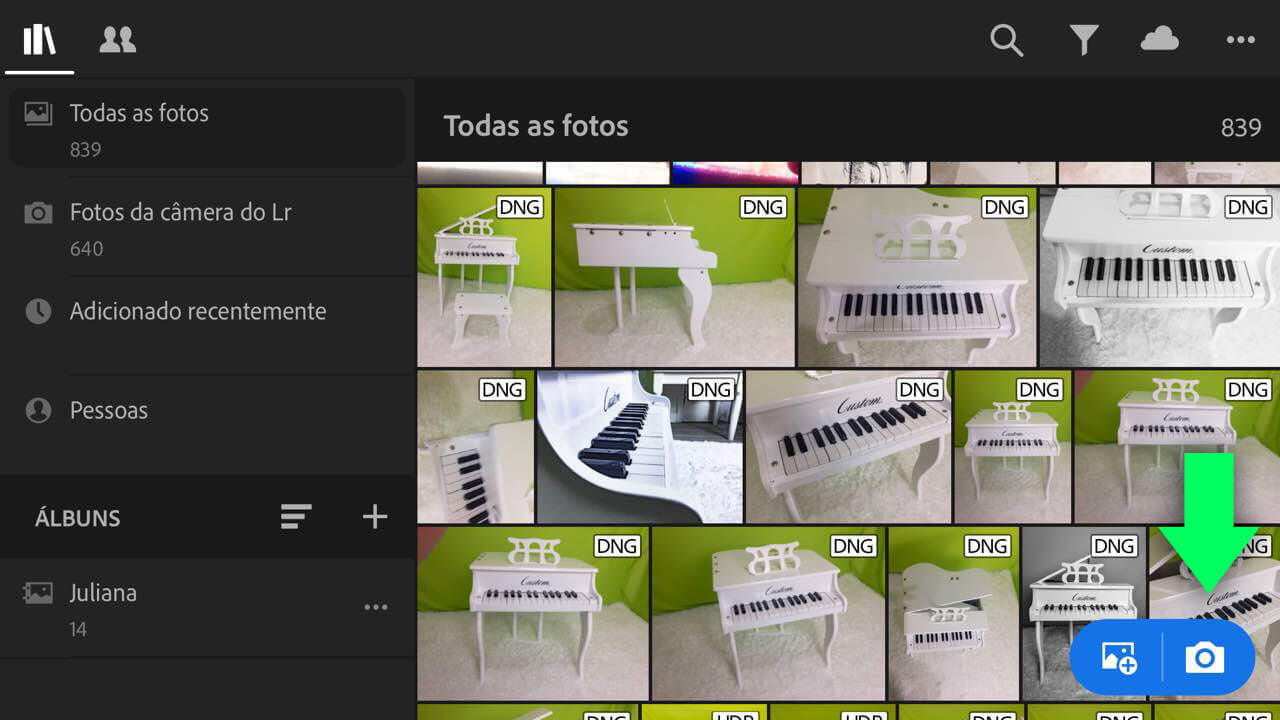

Assim que você abre o app do Adobe Lightroom CC, você verá, no canto inferior direito, a opção de abrir a câmera. Além disso, ele já carrega as fotos mais recentes e álbuns.

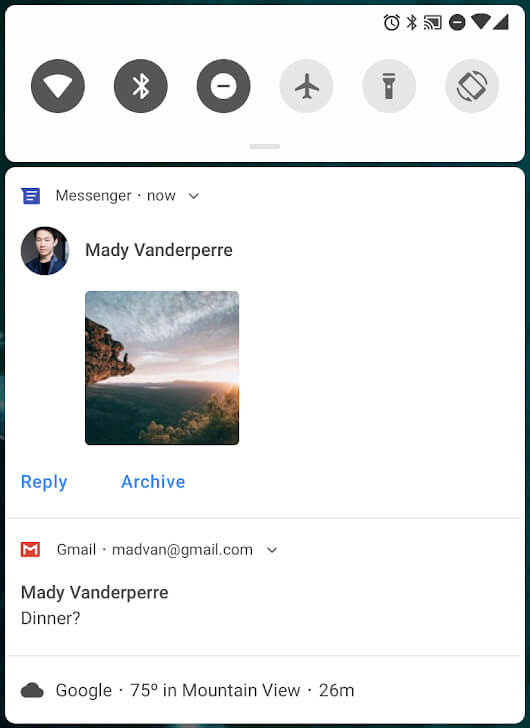

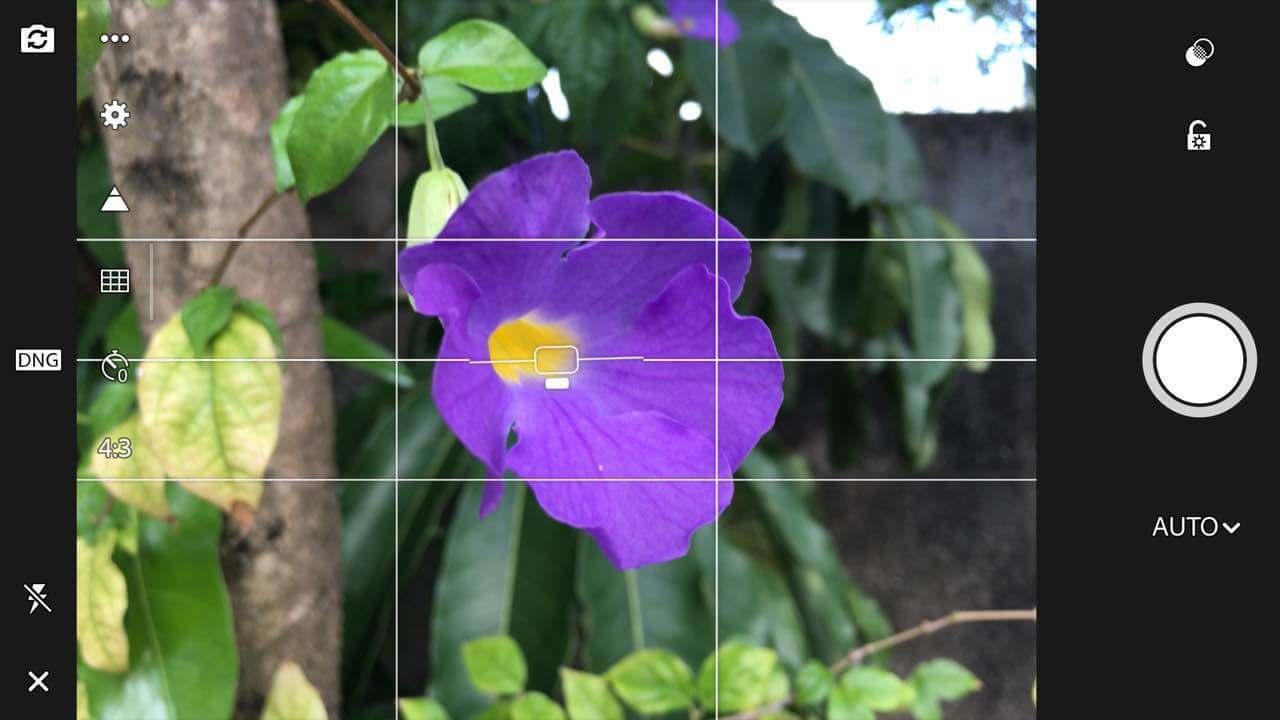

De início temos uma câmera comum, com funções comuns da maioria das câmeras digitais, como temporizador e grade. Tirar uma foto com as funções automáticas da câmera já apresentam uma qualidade muito boa em relação aos apps de câmeras normais e até os nativos de alguns smartphones.

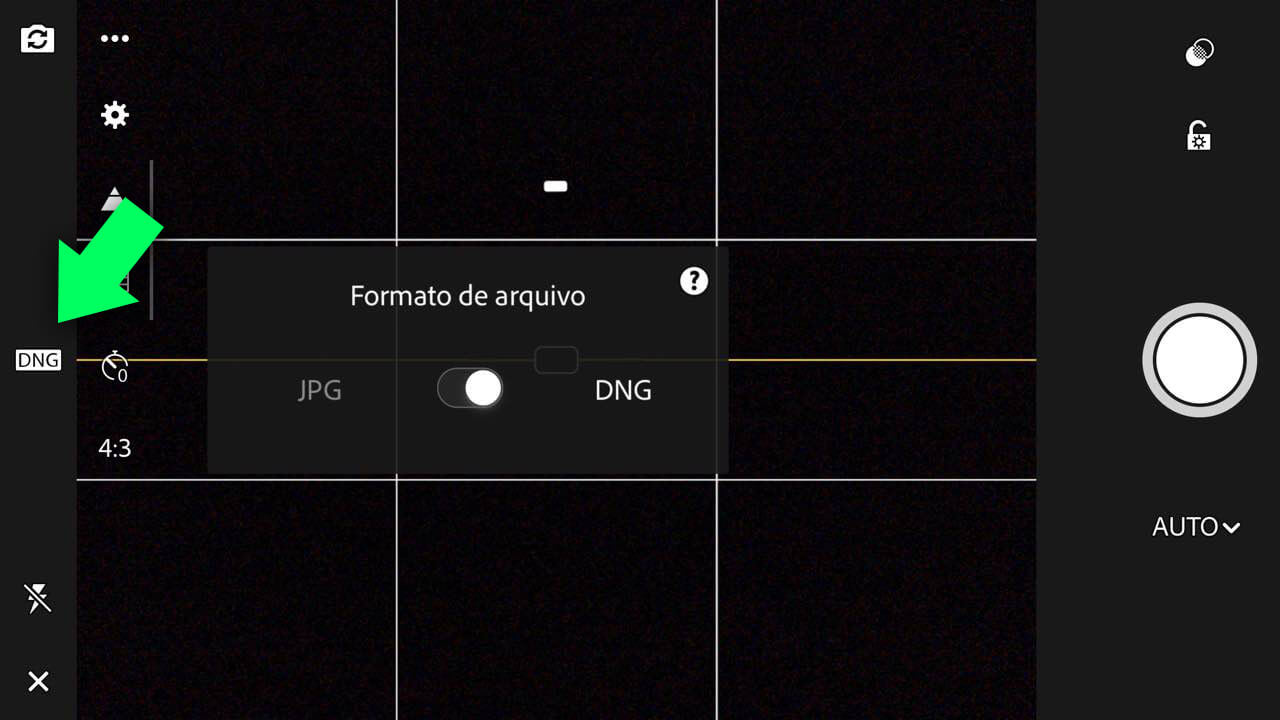

A primeira diferença entre as fotos tiradas com a câmera normal e as câmeras dos smartphone é a possibilidade de tirar fotos em DNG. DNG é uma sigla para Digital Negative (Negativo Digital), um formato RAW da Adobe. RAW são formatos de arquivos raiz, ou seja, são as fotos tiradas diretamente pela câmera sem qualquer compressão ou pós-processamento. A vantagem tirar fotos em RAW é que elas são mais ideais para uma edição posterior, pois guardam informações que normalmente são perdidas com a compressão JPG, principalmente quanto a luminosidade. Como nem tudo são flores, esse formato ocupa mais espaço do seu smartphone, então é aconselhável que você use smartphones com ao menos 32GB de espaço interno ou cartão de memória.

Mas atenção, nem todo smartphone Android compatível com o app possui essa opção. Consulte a página do Adobe Lightroom CC, na Google Play Store para mais detalhes.

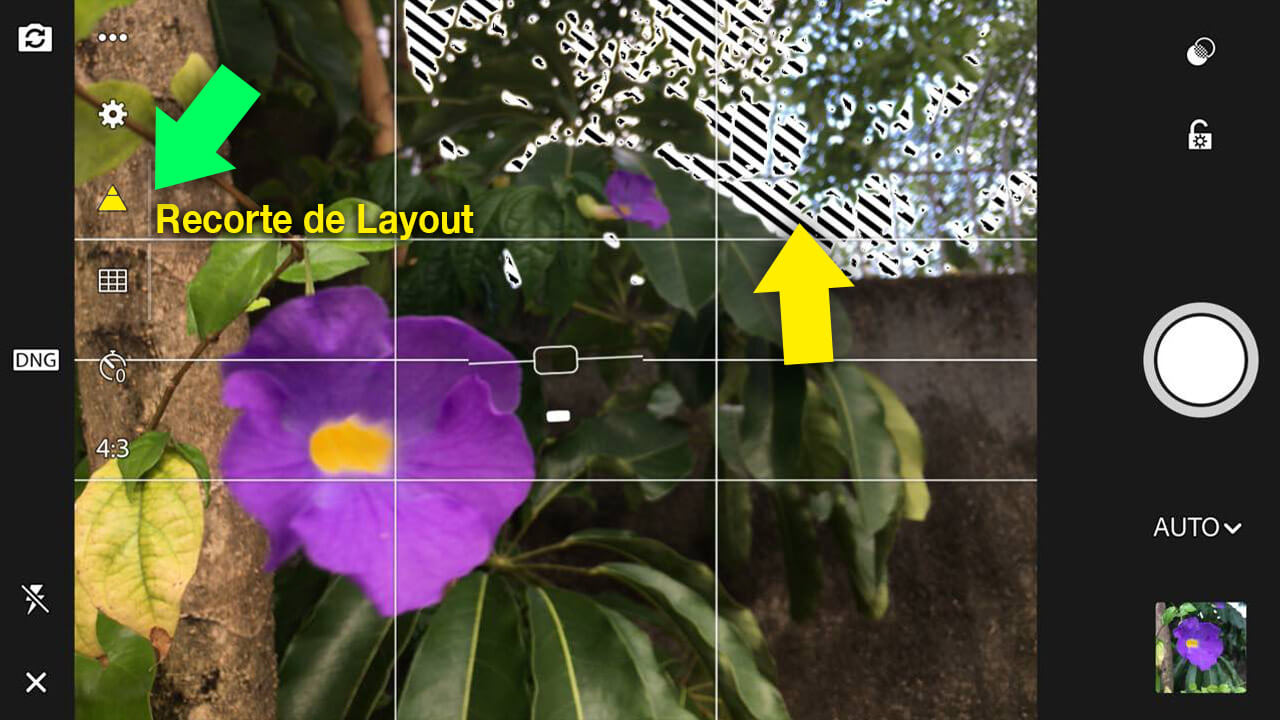

Dentre as opções comuns disponível em todas as áreas da câmera, inclusive no modo automático, vale destacar o Recorte de Layout. Trata-se de uma opção para demarcar com listras todos os pontos da imagem que estão em branco absoluto. Em termos de fotografia, isso é importante para saber onde a foto pode estar “estourando”, indicando áreas muito brancas que não poderão ser editadas posteriormente (pois a diminuição do brilho só a deixaria cinza).

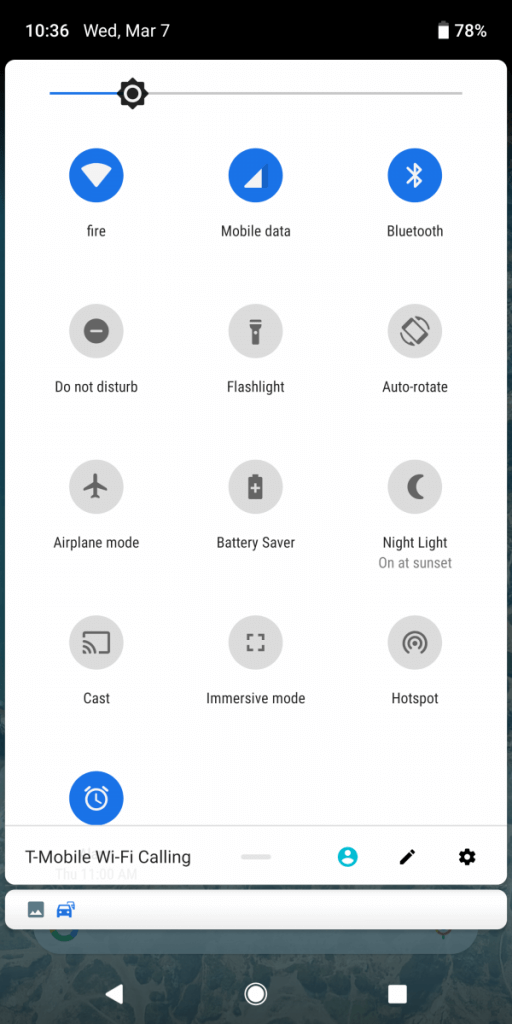

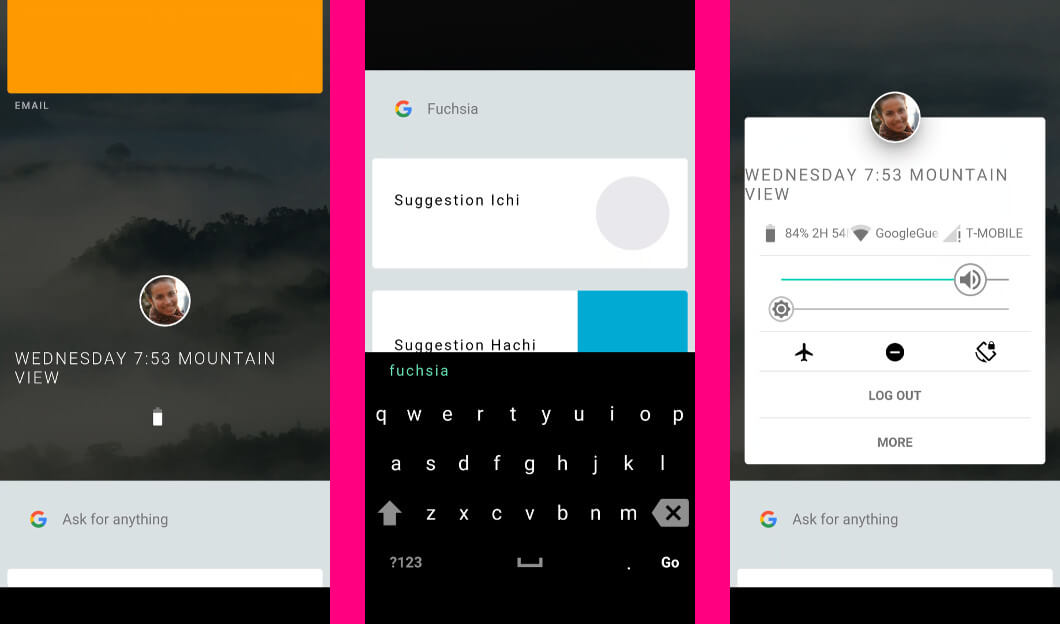

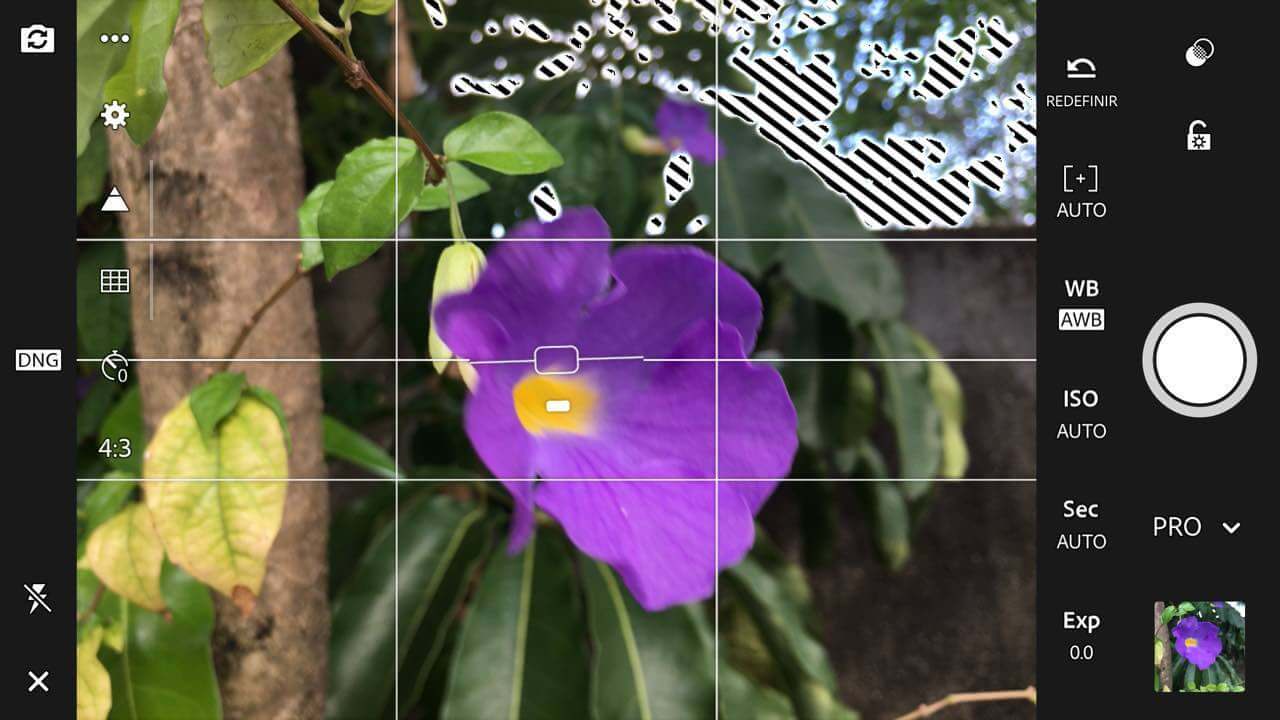

Mas onde o Lightroom se destaca de verdade é no modo PRO. O modo profissional do Adobe Lightroom CC dá opções de exposição, velocidade do obturador, ISO, compensação de cor e, o mais legal, foco manual. Por questão de objetividade, vamos nos concentrar nas funções principais para uma melhor foto em termos de fidelidade, podendo você depois explorar melhor as ferramentas.

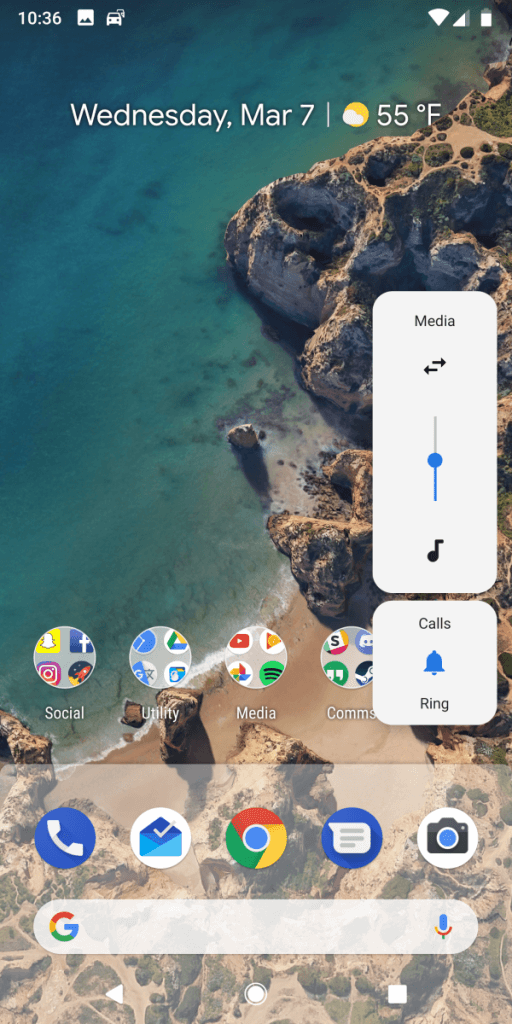

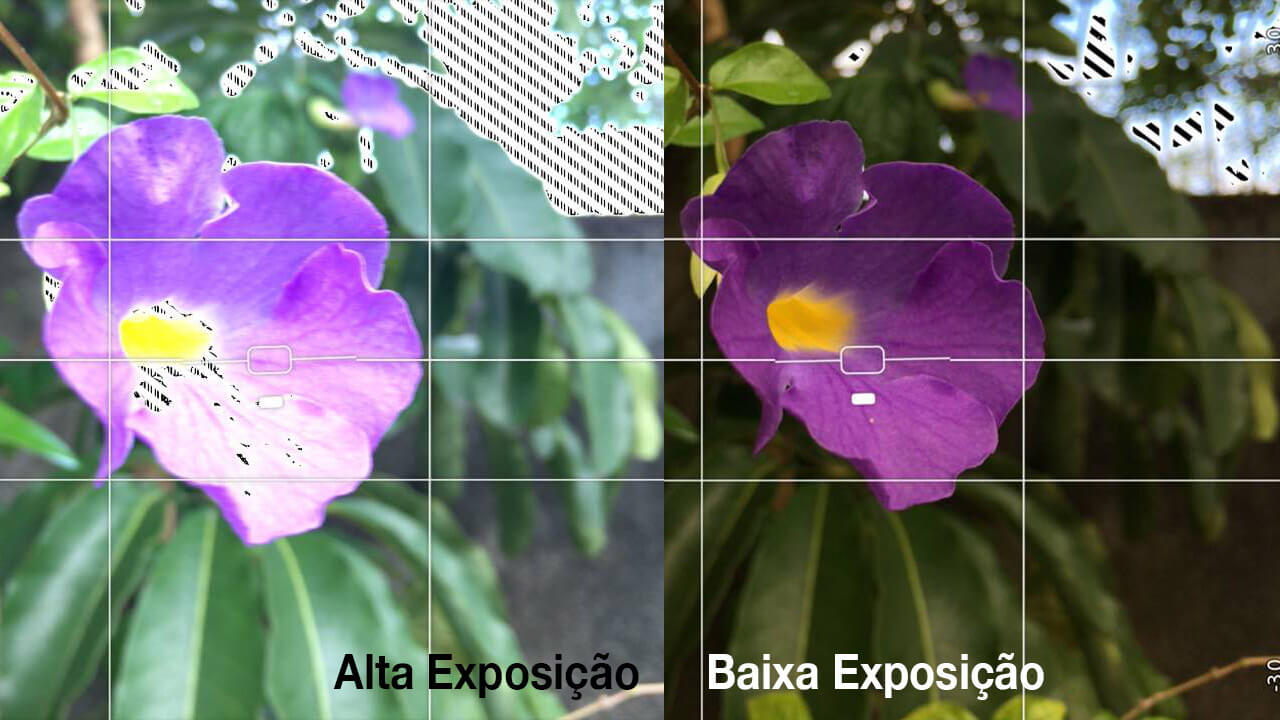

O modo de exposição permite você adicionar ou remover luminosidade à imagem. O controle de Exposição está definido pelo botão Exp, no canto inferior ou lateral direita, dependendo da orientação. Basicamente é você deixar a imagem mais clara ou mais escura.

Uma das ferramentas mais importantes é a Velocidade do Obturador, definido pelo botão Sec. A velocidade do Obturar controla o tempo em que o obturador vai ficar aberto para gravar a imagem no sensor. Isso significa que quanto mais tempo aberto, mais luz e, por consequência, mais informação será armazenada.

A velocidade, nessa ferramenta, é definida pela fração de segundo, indo de 1/10000 à 1/4. Quanto mais rápido, menos luz vai entrar, mas você conseguirá pegar imagens onde tem mais movimento (como corridas, eventos esportivos, etc. – use em ambientes claros), e quanto mais lento mais luz vai entrar, o que deixará a foto bem mais nítida, porém você deverá deixar a câmera imóvel – ideal uso de tripé – por mais tempo. A velocidade baixa é excelente para fotos em locais mais escuros (dispensando, muitas vezes, até o flash), natureza morta e objetos que exijam muitos detalhes. Você deverá ajustar essa configuração de acordo com cada caso.

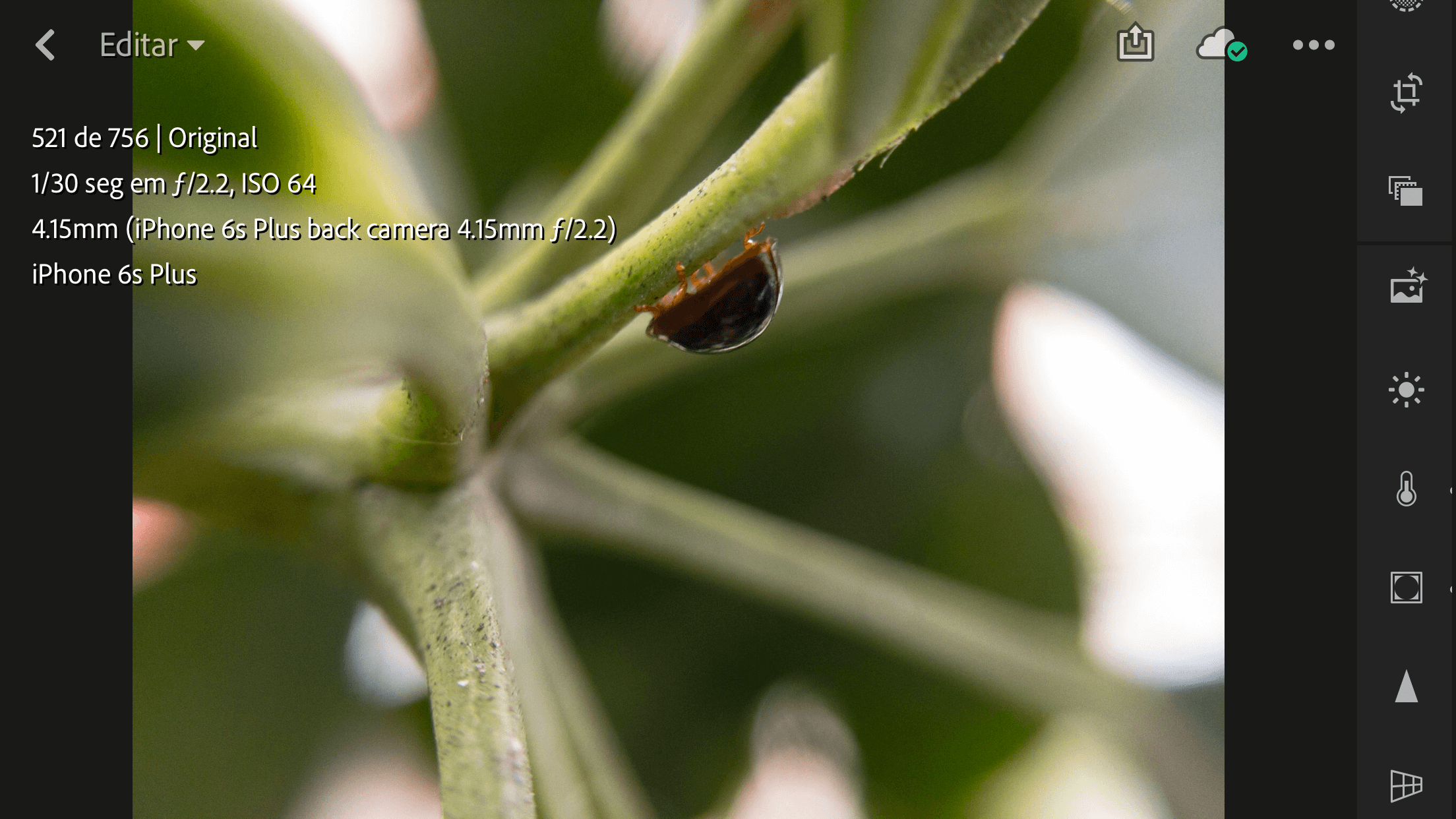

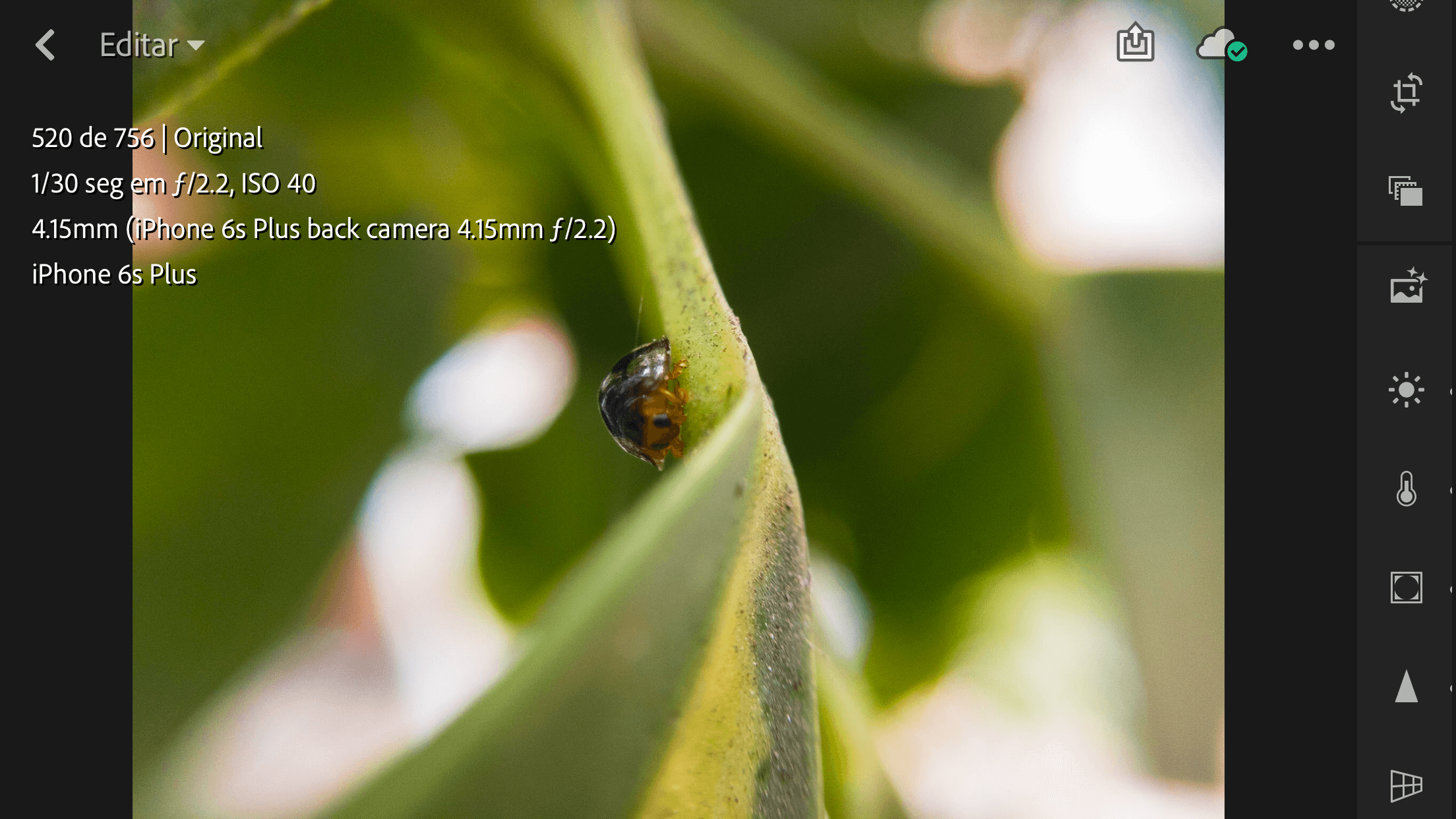

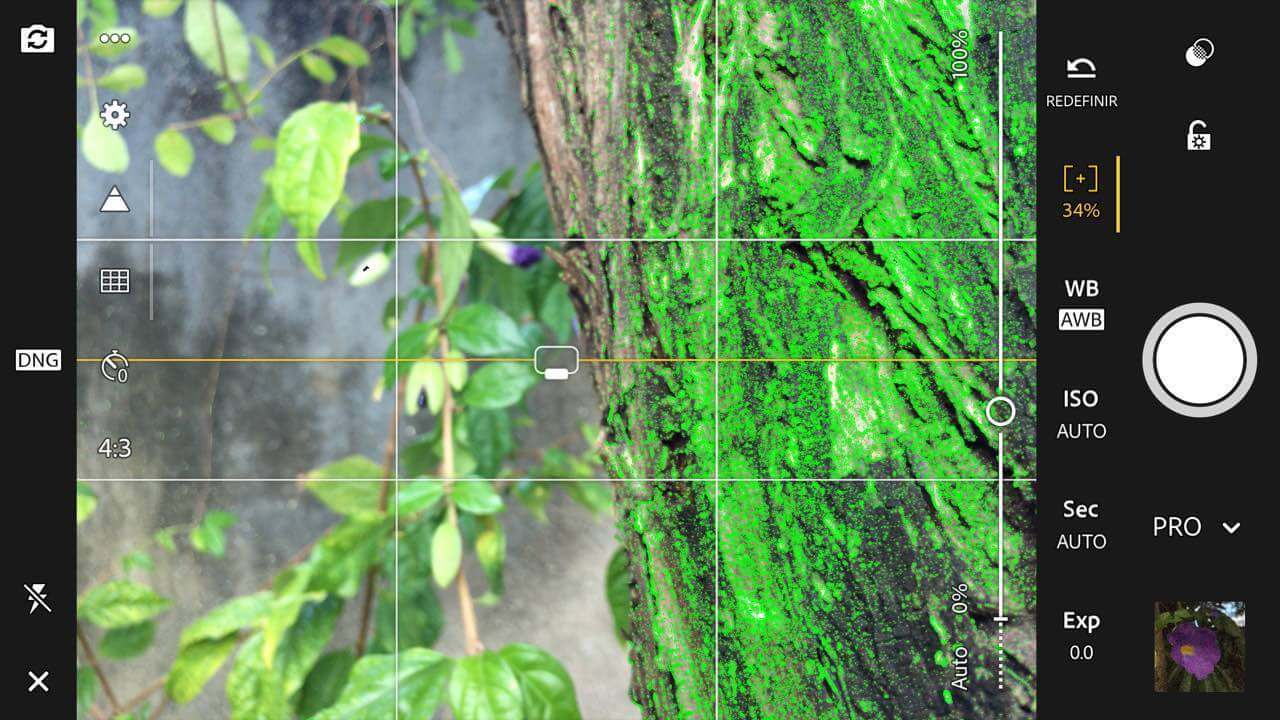

A segunda função mais importante é o Foco Manual, definido pelo ícone [+]. Por padrão o foco está no automático e pode ser definido com o toque na tela, como a câmera nativa. Porém, você poderá controlar o foco manualmente, mesmo com smartphone de apenas uma câmera, e isso dá resultados muito interessantes. Vale salientar que isso é um foco real e não um pós-processamento comum em muitos aparelhos. A linha do foco vai de mais perto (ideal para macros) para mais longe (ideal para imagens em campos abertos), que você pode alternar pelo ponto que você deseja que seja o seu assunto da foto.

Você deve ter reparado que o objeto em foco ficou com um contorno verde. Essa detecção de bordas é fundamental para você entender bem onde está o foco. Diferente de câmeras profissionais, que possuem o visor (Viewfinder) – o buraquinho para colocar o olho – o smartphone é totalmente dependente da tela. Como uma tela possui limitações, as bordas ajudam a ter mais certeza de onde está o foco da imagem.

Lembrando que o resultado final, obviamente, não gravará as linhas de bordas.

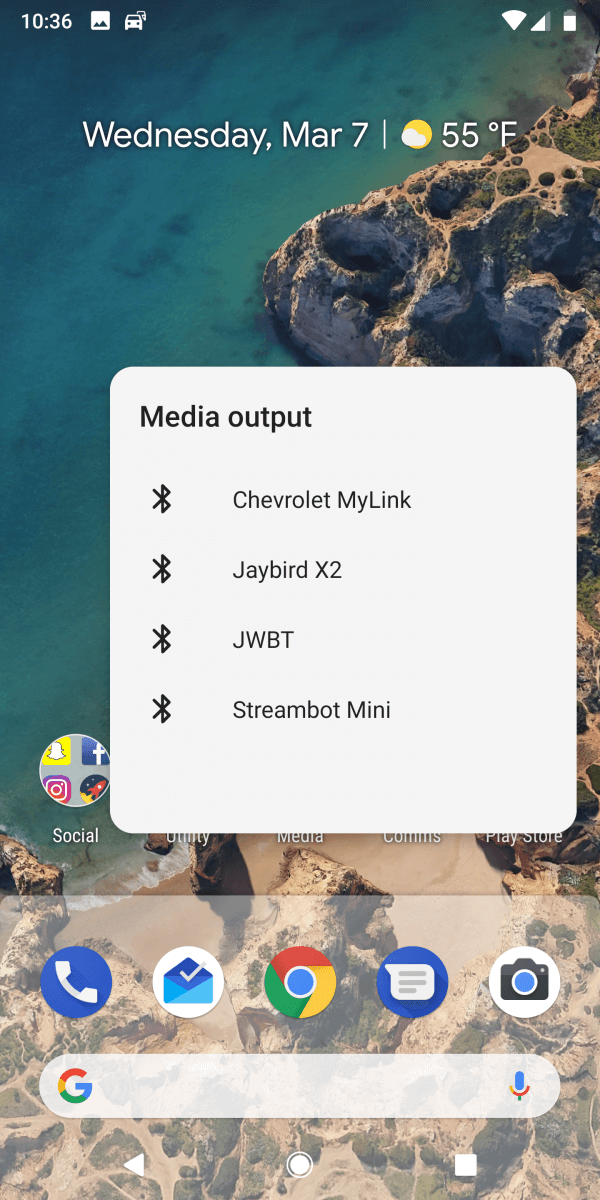

O último modo a ser apresentado é o HDR. O High Dynamic Range (HDR) é uma técnica de sobreposição de diversas fotos tiradas em exposições diferentes, que são mescladas para tirar uma foto mais natural.

Quando olhamos para uma parede com uma janela, ou o céu através dos galhos das árvores, nossos olhos e nosso cérebro conseguem interpretar as nuances de luminosidade em cada assunto. A lente, entretanto, não consegue fazer o mesmo, precisando focar a luminosidade a partir de um ponto específico. Quando você alterna a exposição você está justamente modificando o ponto de qual luminosidade o sensor deve se basear.

Para poder usar o modo HDR é importante que o usuário use um tripé ou não se mexa, pois várias fotos serão tiradas em um curto intervalo de tempo, em exposições diferentes. O processamento do HDR ocorre aos poucos, em plano de fundo, pelo aplicativo, de forma que poderá demorar um pouco para a imagem aparecer na biblioteca. Esse processamento consiste na junção inteligente dessas imagens ao ponto que seja ajustado para que os tons fiquem mais fiéis ao olho humano. O Adobe Lightroom CC ainda irá fazer um ajuste automático da imagem, que poderá ser desfeito ou modificado de acordo com a vontade do fotógrafo.

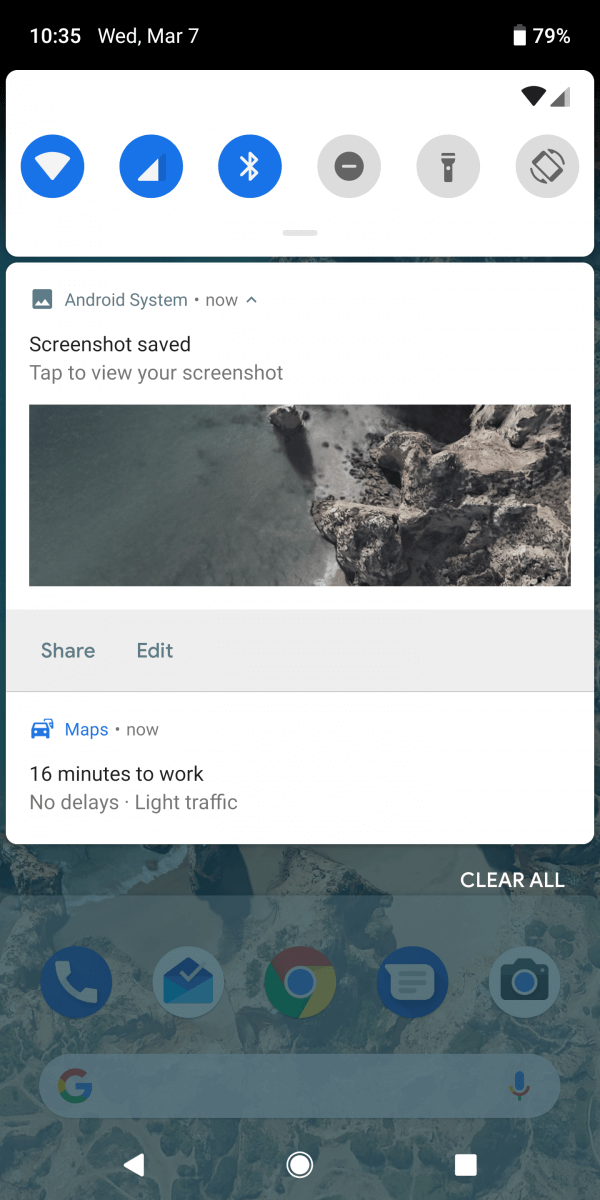

Ferramentas de Edição

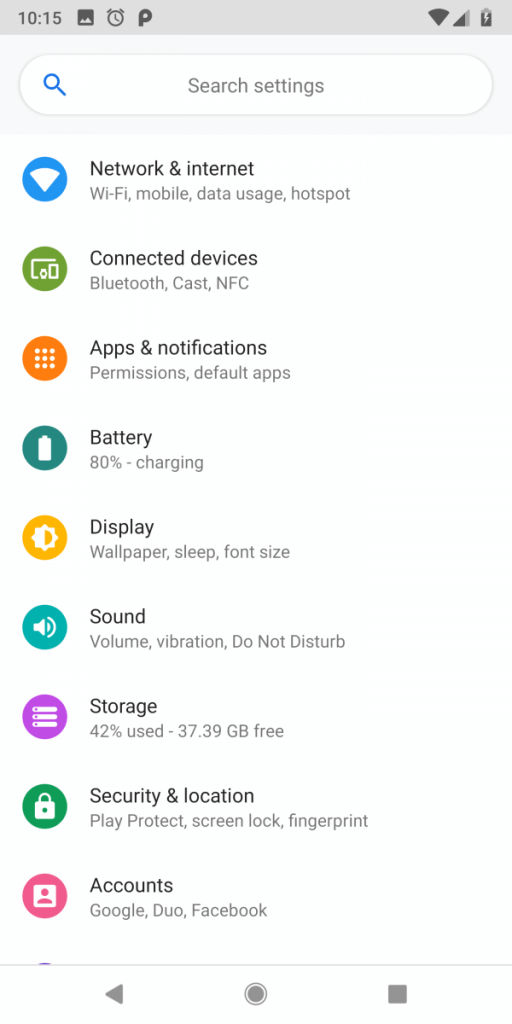

Após tirar a fotografia, você provavelmente irá querer ajustar brilho, contraste, nitidez, cores, etc. O Adobe Lightroom CC mobile traz as mesmas opções que estão incluídas na versão desktop. Para quem é assinante da Adobe, ainda tem algumas opções a mais, mas iremos nos concentrar nas principais opções disponíveis na versão gratuita.

Entretanto, se você possuir um dos planos, a foto será sincronizada com o Adobe Cloud, ficando disponível na versão web ou desktop do Lightroom, podendo você, se for de sua preferência, editar a foto no iPad, Tablet Android ou no computador.

Para iniciar a edição, basta voltar para a biblioteca e escolher a foto que você deseja editar. Lembre-se que imagens em DNG terão um resultado melhor para edição.

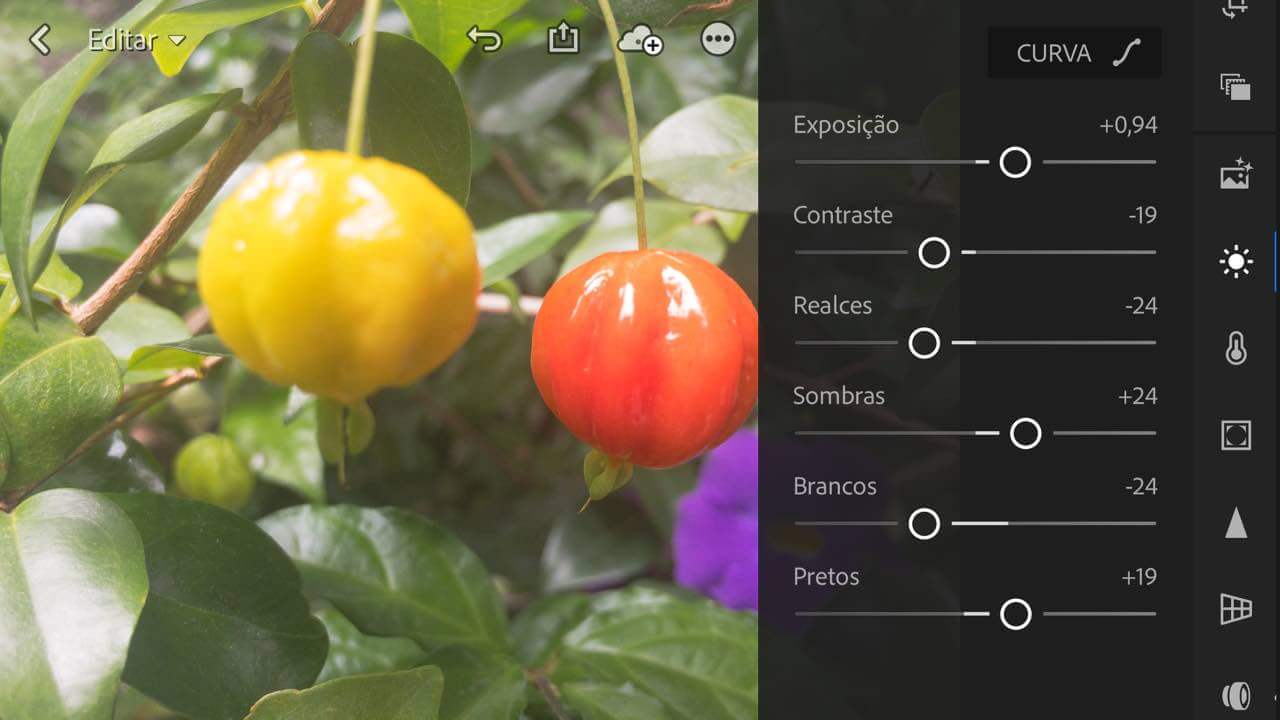

Iniciando pelo controle de luminosidade, o usuário poderá editar o brilho, contraste e pontos claros e escuros específicos na imagem. Apenas com uma foto RAW (neste caso, DNG) você vai conseguir realmente clarear uma foto escura. Se você tentar fazer isso com uma foto JPG, por conta da compactação, simplesmente você vai ter um acinzentado e não os tons reais de cores da imagem.

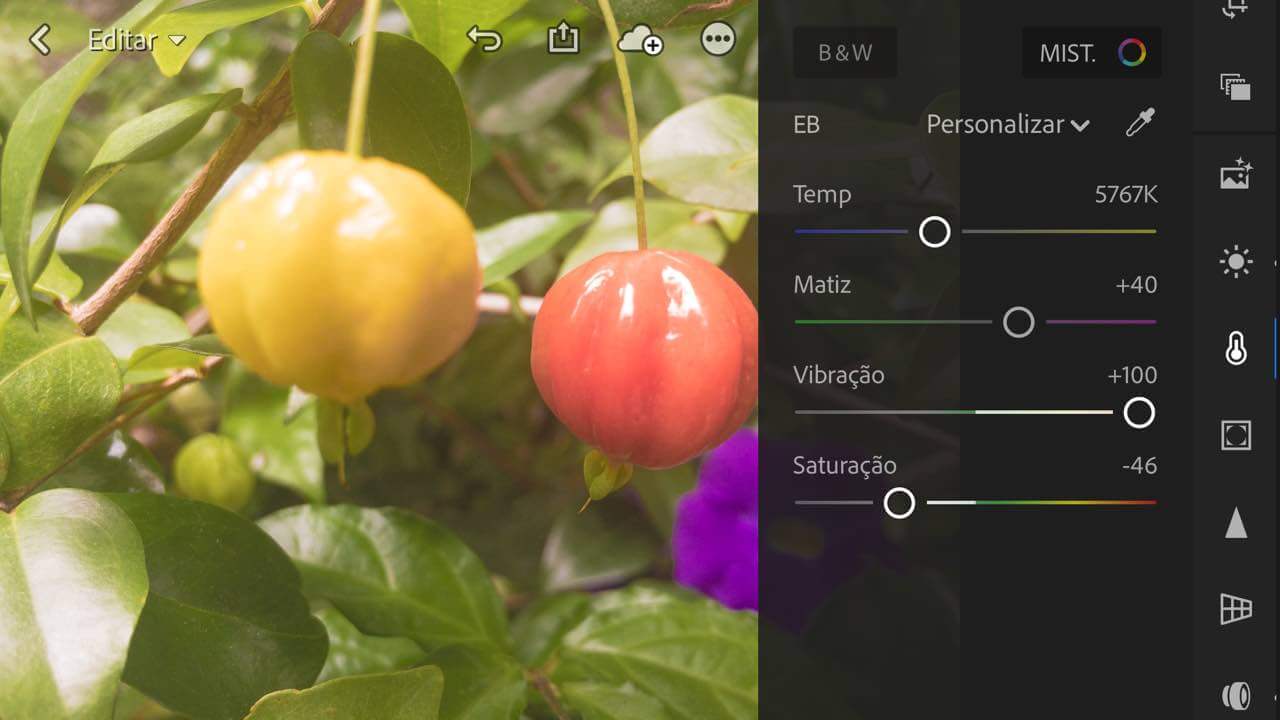

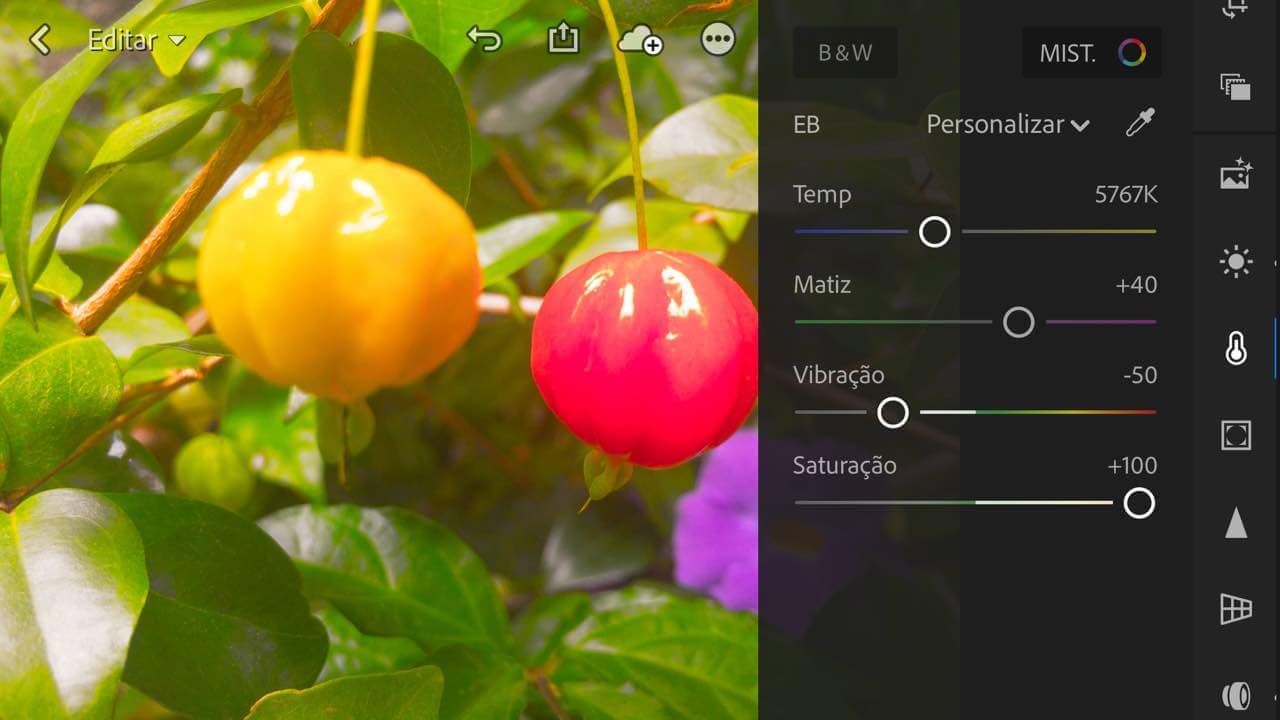

Quanto ao controle de cores, vale uma observação importante. Além de temperatura, matiz e outras opções mais comuns, você vai encontrar a opção de Vibratilidade e a de Saturação.

Enquanto a Saturação define realmente a intensidade da cor, indo de tons de cinza até cores extremamente intensas, a Vibratilidade aumenta a saturação das cores menos saturadas para que fiquem mais próximas as mais saturadas, deixando a imagem mais homogênea. Quando diminuída, por exemplo, pode previnir que a cor de pele fique muito saturada em imagens muito coloridas (como em fotos tiradas em praias).

A qualidade das cores da imagem vai depender, principalmente, no ajuste refinado entre saturação e vibratilidade. A boa escolha desses tons vai resultar em uma imagem de qualidade ou uma imagem com cores berrantes ou desbotadas.

O controle de Nitidez é extremamente importante, não apenas pelo que o próprio nome diz (aumentar a nitidez da imagem), como é a área onde se configura o redutor de ruído. Quanto menos luz é captada pelo sensor, mais ruído pode ser causado na imagem. Esse ruído pode atingir toda a composição geral da imagem ou apenas ser variações de cores. Você pode ajustar o redutor de ruído direto nessa ferramenta de Nitidez. Vale lembrar que quanto mais nitidez, mais redução de ruído você deverá usar.

Fotos tiradas com menor tempo de abertura do obturador tende a possuir mais ruídos.

Porém, a nitidez nem sempre é a melhor forma de efetivamente deixar a imagem mais definida. Em uma imagem eletrônica, a nitidez se refere a intensidade do pixel em relação ao pixel mais próximo. Em relação a composição da imagem como um todo, a definição dos objetos devem ser feitas a partir do contraste dos elementos, como em um desenho feito à lápis. A ferramenta Efeitos possui as opções de Claridade e Desembaçar que adicionarão uma definição maior da imagem. Para isso, ela mexerá em pontos específicos dos níveis e contrastes e sua intensidade poderá ser reduzida ou aumentada de acordo com o resultado desejado.

Vale salientar que o ajuste de Claridade aumenta o contraste pela mesma forma que a claridade do sol deixa a sombra mais escura e, por isso, com os elementos mais definidos.

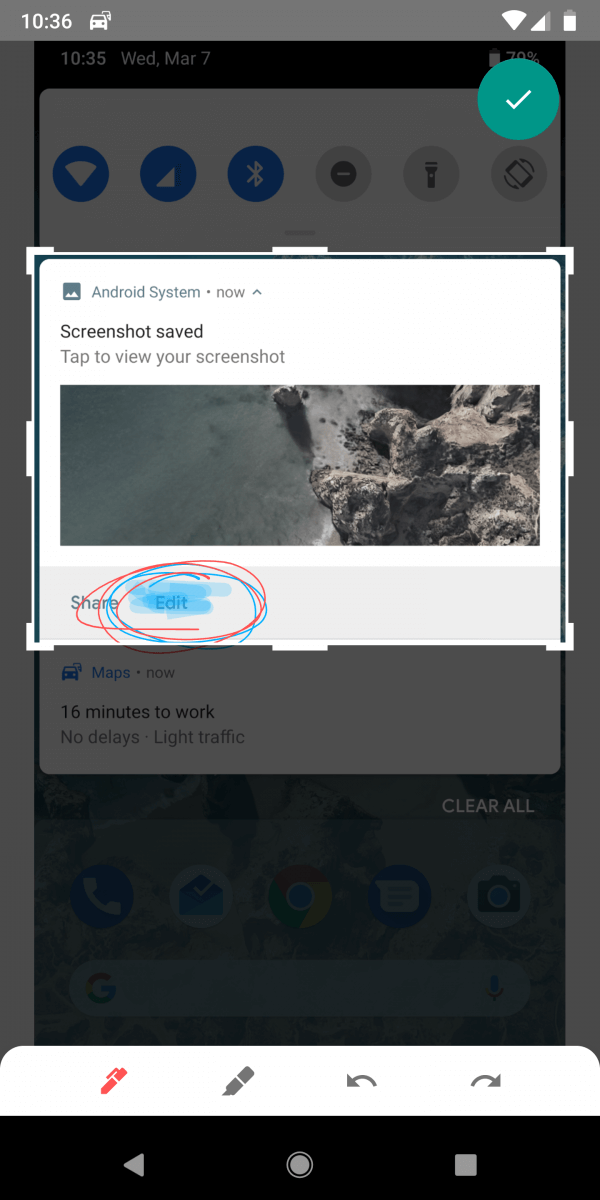

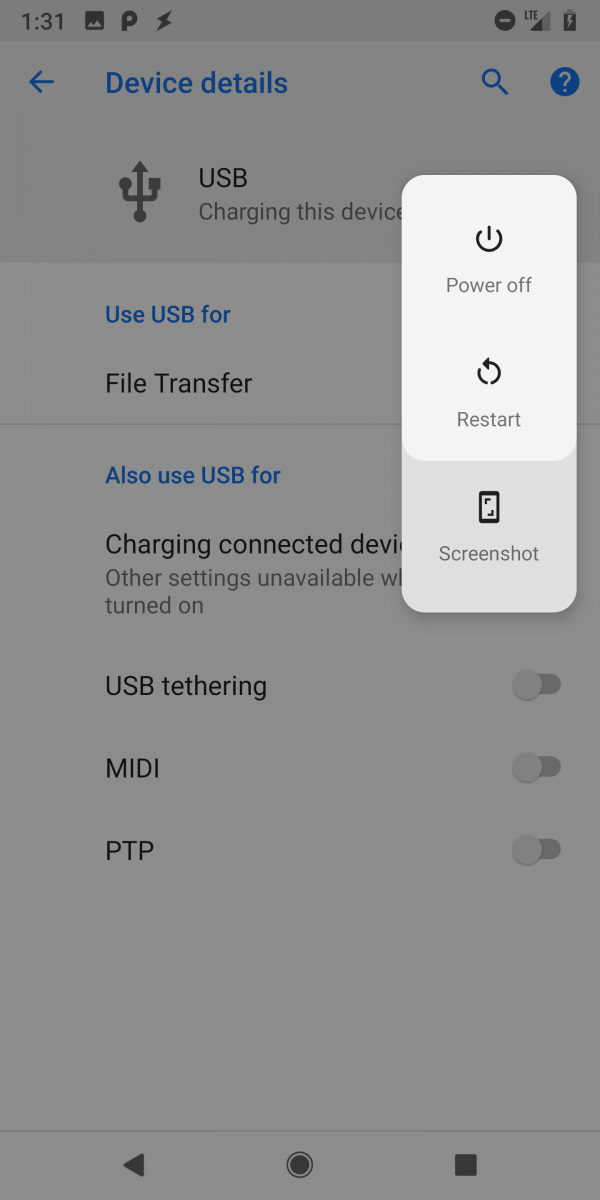

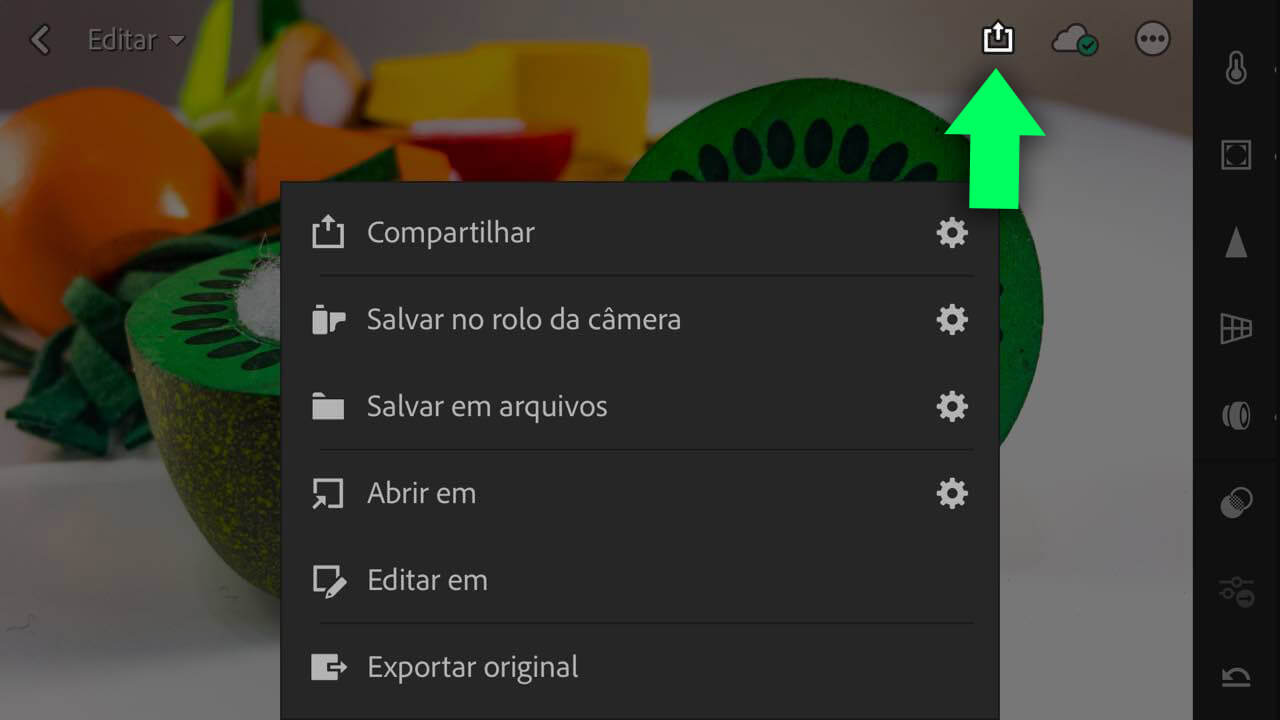

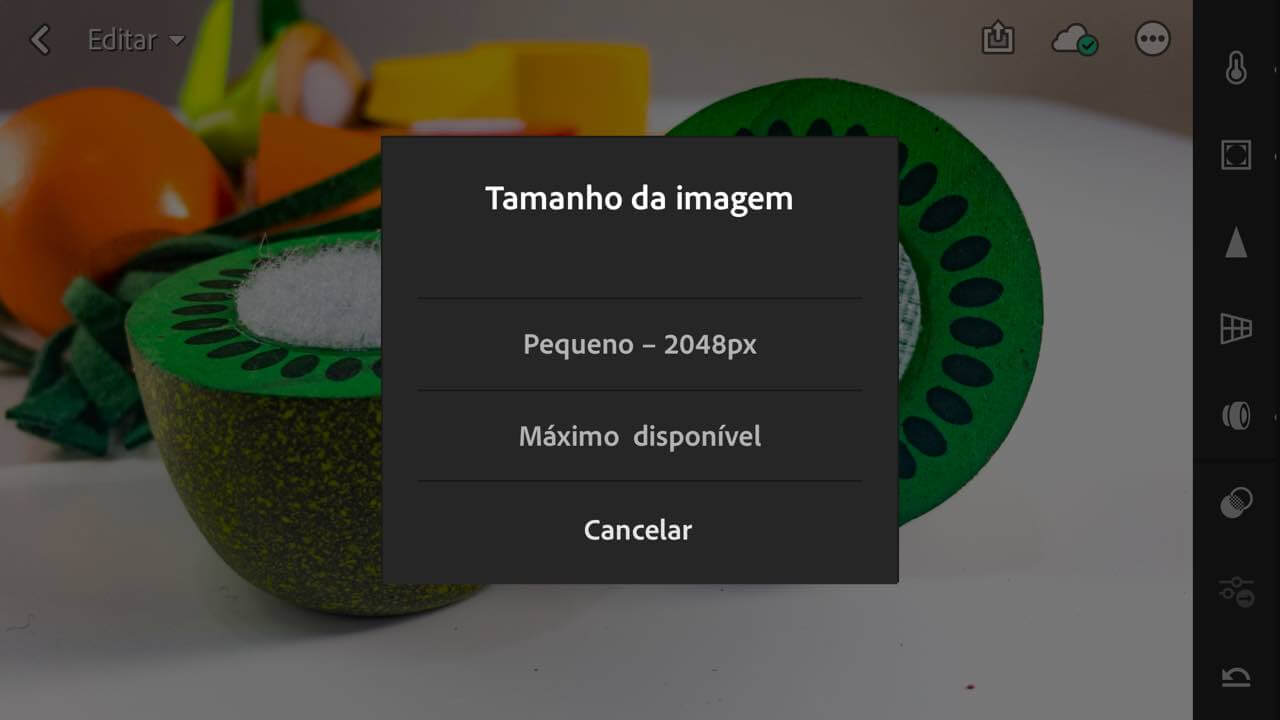

A foto DNG não pode ser compartilhada diretamente e não estará em seu app de fotos. Para exportar a foto, você deverá clicar no ícone de compartilhamento e escolher a opção desejada. Ao salvar no rolo da câmera, o Adobe Lightroom CC irá perguntar se você quer salvar em uma resolução mais leve, para publicar em mídias sociais, ou com a maior resolução possível, o que dependerá da quantidade de megapixels de seu dispositivo.

Concluindo

Tirar fotos com o smartphone, de forma mais profissional, é ideal para quem trabalha com social media, websites, e-commerces e outros ambientes que exijam o compartilhamento rápido digital. Com configurações mais refinadas, é possível chegar a fotografias bem próximas a câmeras profissionais ou, ao menos, suficientes para a maioria dos casos.

O que vimos aqui foram as principais ferramentas, com dicas para melhor qualidade de foto. O ideal é que você pratique, teste, experimente a maior quantidade possível de opções e ferramentas, para chegar no resultado ideal para você.

O Adobe Lightroom CC é gratuito, mas há mais opções disponíveis para quem usa qualquer um dos planos da Adobe.